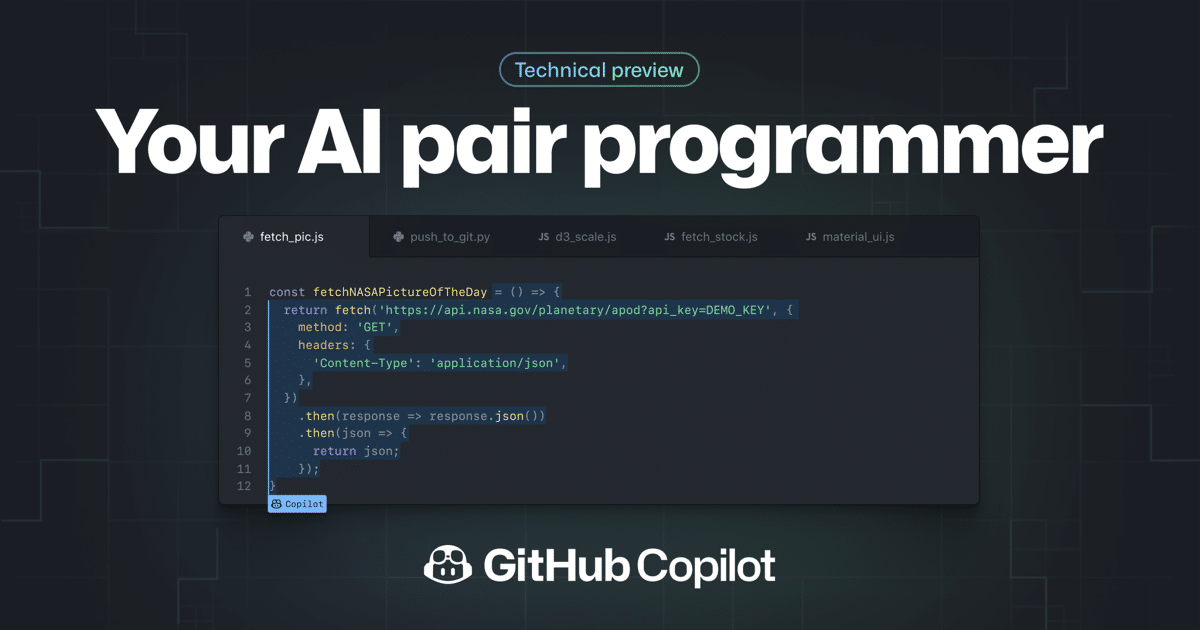

Niedawno dzielimy się tutaj na blogu wiadomością z «Copilot» który jest sztuczna inteligencja, która obiecuje zaoszczędzić czas pomagając w pisaniu kodu użytkownika z własnymi sugestiami, które są oparte na miliardach linii kodu publicznego, których użytkownicy publicznie wnieśli swój wkład do GitHub, przy użyciu systemu sztucznej inteligencji o nazwie Codex firmy badawczej OpenAI.

Podczas gdy drugi pilot to świetna oszczędność czasu a GitHub opisuje Copilot jako odpowiednik AI „programowania w parach”, w którym dwóch programistów pracuje razem na jednym komputerze. Chodzi o to, aby jeden programista mógł wymyślić nowe pomysły lub wykryć problemy, które mógł przeoczyć drugi programista, nawet jeśli wymaga to więcej godzin pracy.

W praktyceJednak Copilot jest bardziej narzędziem pozwalającym zaoszczędzić czas, ponieważ integruje zasoby, których programiści musieliby szukać gdzie indziej. Gdy użytkownicy wprowadzają dane do Copilot, narzędzie sugeruje fragmenty aby dodać je jednym kliknięciem. W ten sposób nie muszą tracić czasu na szukanie dokumentacji API lub szukanie przykładowego kodu na stronach takich jak StackOverflow.

Sieć neuronowa w GitHub Copilot jest szkolona przy użyciu ogromnych ilości danych, składających się z kodu – milionów wierszy przesłanych przez 65 milionów użytkowników GitHub, największej na świecie platformy dla programistów do współpracy i dzielenia się swoją pracą.

Celem jest, aby Copilot nauczył się wystarczająco dużo o wzorcach kodu, aby móc samodzielnie hakować. Możesz pobrać niekompletny kod od ludzkiego partnera i dokończyć pracę, dodając brakujące części. W większości przypadków wydaje się, że to się udaje. GitHub planuje sprzedaż dostępu do narzędzia deweloperom.

Jak większość narzędzi sztucznej inteligencji, GitHub chce również, aby Copilot stawał się coraz bardziej inteligentny na podstawie gromadzonych danych użytkowników.

Gdy użytkownicy zaakceptują lub odrzucą sugestie Copilot, ich model uczenia maszynowego użyje tych informacji zwrotnych do ulepszenia przyszłych sugestii, dzięki czemu narzędzie stanie się bardziej ludzkie w miarę uczenia się.

Krótko po uruchomieniu drugiego pilota, niektórzy programiści zaczęli być zaniepokojeni użyciem kodu publicznego trenować sztuczną inteligencję narzędzia. Jedną z obaw jest to, że Jeśli Copilot odtworzy wystarczająco duże fragmenty istniejącego kodu, może to być naruszenie praw autorskich lub prać kod open source do użytku komercyjnego bez odpowiedniej licencji.

O tym Fundacja Wolnego Oprogramowania ogłosiła, że ogłosiła zaproszenie finansowane na żądanie raportów technicznych na temat konsekwencji Copilot dla społeczności wolnego oprogramowania

„Wiemy już, że Copilot jest niedopuszczalny i niesprawiedliwy z naszego punktu widzenia. Wymaga uruchomienia niewolnego oprogramowania (Visual Studio lub części Visual Studio Code), a Copilot jest usługą zastępującą oprogramowanie.

Powodem jest to, że Copilot wymaga uruchomienia niewolnego oprogramowania, jako Microsoft Visual Studio IDE lub wydawca Visual Studio Code, utrzymuje FSF i stanowi „usługę zastępującą oprogramowanie”, co oznacza, że jest sposobem na zdobycie władzy nad komputerami innych osób.

Ponieważ jako taki Copilot to rozszerzenie Visual Studio Code, które wykorzystuje uczenie maszynowe przeszkoleni w zakresie wolnego oprogramowania open source, aby sugerować linijki kodu lub funkcje programistom podczas pisania oprogramowania.

Drugi pilot podnosi jednak wiele innych pytań, które wymagają dalszego rozważenia.

„Fundacja Wolnego Oprogramowania otrzymała wiele zapytań o nasze stanowisko w tych kwestiach. Widzimy, że korzystanie przez Copilot z oprogramowania open source ma wiele implikacji dla dużej części społeczności wolnego oprogramowania. Deweloperzy chcą wiedzieć, czy szkolenie sieci neuronowej w ich oprogramowaniu rzeczywiście można uznać za dozwolony użytek. Inni, którzy mogą być zainteresowani korzystaniem z Copilot, zastanawiają się, czy fragmenty kodu i inne materiały skopiowane z repozytoriów hostowanych na GitHub mogą spowodować naruszenie praw autorskich.

źródło: https://www.fsf.org/