Już KZKG ^ Gaara pokazał nam, jak to zrobić mierzyć wydajność naszych dysków twardych o CPU naszych komputerów, a teraz pokażę ci, jak mierzyć wydajność GPU (inaczej jednostka procesora graficznego) lub jednostka przetwarzania grafiki w języku hiszpańskim.

Do tego możemy użyć dwóch narzędzi glmark2 y glx-przekładnia, który jest zawarty w pakiecie naczynia stołowe.

GLX-Sprzęt

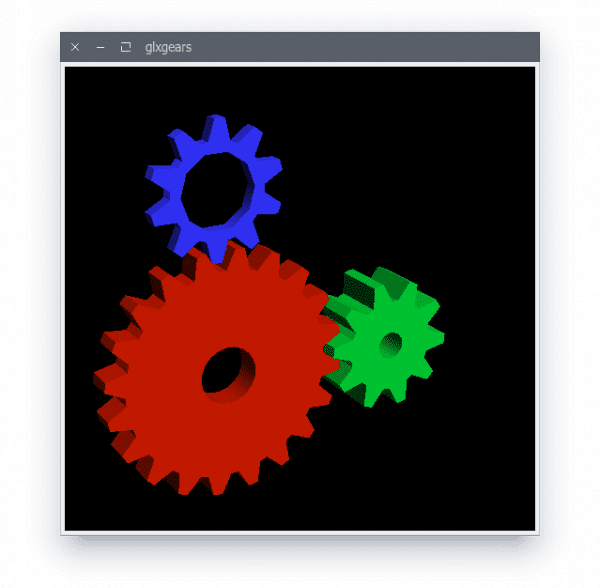

GLX-Gear, jak powiedziałem wcześniej, jest częścią pakietu mesa-utils i powiedzmy, że jest to jedna z dwóch opcji, które dziś pokazuję, najbardziej znana lub popularna, jednak nie jest do tego najlepsza. Po zainstalowaniu pakietu mesa-utils uruchamiamy go, wykonując w terminalu:

$ glxgears

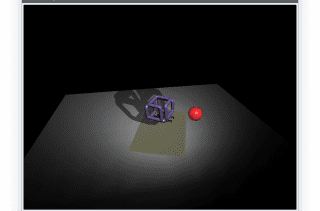

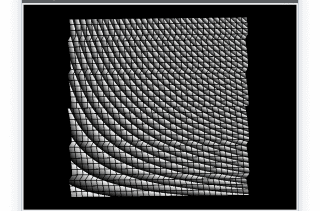

który pokaże nam poruszające się koła zębate, coś takiego:

Tymczasem w terminalu pokazuje statystyki, którymi w moim przypadku były:

Praca zsynchronizowana z odświeżaniem pionowym. Szybkość klatek powinna być mniej więcej taka sama, jak częstotliwość odświeżania monitora. 467 klatek w 5.0 sekund = 93.200 FPS 385 klatek w 5.0 sekund = 76.835 FPS 300 klatek w 5.0 sekund = 59.873 406 FPS 5.0 klatek w 80.952 sekund = 438 5.0 FPS 87.493 klatek w 399 sekund = 5.0 79.626 FPS 300 klatek w 5.0 sekund = 59.871 300 FPS 5.0 klatek w 59.873 sekund = 300 5.0 FPS 59.869 klatek w 300 sekund = 5.0 59.868 FPS 413 klatek w 5.0 sekund = 82.424 324 FPS 5.0 klatek w 64.662 sekund = XNUMX XNUMX FPS XNUMX klatek w XNUMX sekund = XNUMX FPS XNUMX klatki w XNUMX sekund = XNUMX XNUMX FPS

GL znak 2

Z tego, co testowałem, jest dużo bardziej kompletny niż GLX-Gear i mierzy takie parametry jak bufor, konstrukcja, tekstury, oświetlenie, cienie, ukształtowanie terenu ... itd. Narzędzie to zostało opracowane przez zespół dystrybucji skupiającej się na procesorach ARM tzw Linaro.

Aby zainstalować go w Ubuntu i pochodnych, wystarczy wykonać:

$ sudo apt-get install glmark2

aw przypadku ArchLinux i pochodnych musimy to zrobić z AUR:

$ yaourt -S glmark2

później otwieramy terminal i uruchamiamy test wpisując:

$ glmark2

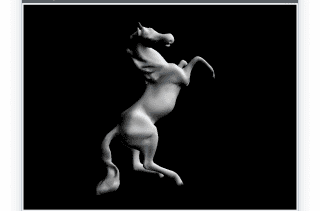

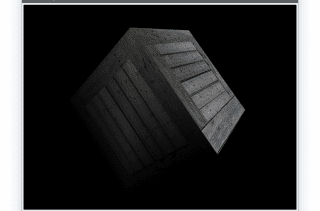

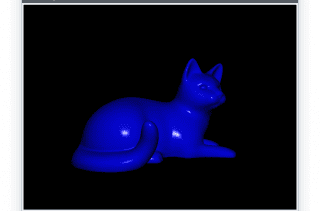

GLMark2 pokazuje nam serię sekwencji podczas drukowania statystyk na konsoli.

W moim konkretnym przypadku ze zintegrowanym procesorem graficznym Intel zwrócił:

================================================ == === glmark2 2014.03 ========================================= ==== ======== Informacje o OpenGL GL_VENDOR: Centrum technologii Intel Open Source GL_RENDERER: Tabela Intel DRI (R) Ivybridge Mobile GL_VERSION: 3.0 Tabela 10.6.1 ============= === ======================================== [build] use-vbo = false: FPS : 640 Czas klatki: 1.562 ms [kompilacja] use-vbo = true: FPS: 641 Czas klatki: 1.560 ms [tekstura] texture-filter = najbliższy: FPS: 768 Czas klatki: 1.302 ms [tekstura] texture-filter = linear: FPS: 786 FrameTime: 1.272 ms [texture] texture-filter = mipmap: FPS: 866 FrameTime: 1.155 ms [shading] shading = gouraud: FPS: 506 FrameTime: 1.976 ms [shading] shading = blinn-phong-inf: FPS: 536 FrameTime: 1.866 ms [cieniowanie] cieniowanie = phong: FPS: 496 FrameTime: 2.016 ms [shading] shading = cel: FPS: 525 FrameTime: 1.905 ms [bump] bump-render = high-poly: FPS: 226 FrameTime: 4.425 ms [bump ] bump-render = normals: FPS: 915 FrameTime: 1.093 ms [bump] bump-render = height: FPS: 898 FrameT ime: 1.114 ms [efekt2d] kernel = 0,1,0, 1, -4,1, 0,1,0;: FPS: 559 FrameTime: 1.789 ms [effect2d] kernel = 1,1,1,1,1; 1,1,1,1,1 , 1,1,1,1,1; 260;: FPS: 3.846 Czas klatek: 5 ms [naciśnięcie] światło = fałsz: quady = 646: tekstura = fałsz: FPS: 1.548 Czas klatek: 5 ms [pulpit] rozmycie- promień = 1: efekt = rozmycie: przebiegi = 4: separable = true: windows = 188: FPS: 5.319 FrameTime: 4 ms [desktop] effect = shadow: windows = 365: FPS: 2.740 FrameTime: 200 ms [bufor] kolumny = 0.9: interleave = false: update-dispersion = 0.5: update-fraction = 363: update-method = map: FPS: 2.755 FrameTime: 200 ms [buffer] columns = 0.9: interleave = false: update- dispersion = 0.5: update- fraction = 498: update-method = subdata: FPS: 2.008 FrameTime: 200 ms [bufor] kolumny = 0.9: interleave = true: update-dispersion = 0.5: update-fraction = 385: update-method = map: FPS: 2.597 FrameTime : 537 ms [pomysły] prędkość = czas trwania: FPS: 1.862 Czas klatki: 361 ms [meduza]: FPS: 2.770 Czas klatki: 48 ms [teren]: FPS: 20.833 Czas klatki: 270 ms [cień]: FPS: 3.704 Czas klatki: 73 13.699 ms [refract]: FPS: 0 Frame Time: 0 ms [warunki warunkowe] fragment-kroki = 750: kroki-wierzchołków = 1.333: FPS: 5 Czas klatki: 0 ms [warunki warunkowe] fragment-kroki = 800: kroki-wierzchołków = 1.250: FPS: 0 Czas klatki: 5 ms [warunkowe] fragment- kroki = 774: kroki wierzchołków = 1.292: FPS: 5 FrameTime: 791 ms [funkcja] fragment-complexity = low: fragment-steps = 1.264: FPS: 5 FrameTime: 811 ms [funkcja] fragment-complexity = medium: fragment- kroki = 1.233: FPS: 5 Czas klatki: 5 ms [pętla] fragment-loop = false: fragment-steps = 794: vertex-steps = 1.259: FPS: 5 FrameTime: 5 ms [pętla] fragment-steps = 798: fragment- uniform = false: vertex-steps = 1.253: FPS: 5 FrameTime: 5 ms [loop] fragment-steps = 764: fragment-uniform = true: vertex-steps = 1.309: FPS: 2 FrameTime: 564 ms ===== ================================================ glmarkXNUMX Wynik : XNUMX =============================================== === ======

Oczywiście przypuszczam, że im wyższy FPS (klatki na sekundę), tym większe będziemy mieli szanse na granie w gry lub oglądanie filmów w wysokich rozdzielczościach, ale nie mam zbyt dużej wiedzy na ten temat.

Inne opcje pomiaru wydajności naszego GPU

Właściwie mamy trzecią opcję, ale jest to przeprowadzenie znacznie bardziej brutalnych testów, że tak powiem. Dla tego musimy pobrać niektóre narzędzia, które oferuje nam za darmo oryginalność.

Bardzo dobrze. Uwaga, Linaro nie jest tak naprawdę dystrybucją. Jest to projekt mający na celu ulepszenie Linuksa na ARM. Na przykład Ubuntu jest częścią Linaro. GCC dołączone do Ubuntu faktycznie umieszcza Linaro w nazwie swojej wersji.

Dobrze 😀

Nie wspomniałeś o innym narzędziu: glxspheres, również będącym częścią zestawu narzędzi stołowych. Używam go do mierzenia wydajności na mojej Nvidia Optimus 😀

Jedno pytanie, w fps glxgears, czy posiadanie ssd jako dysku głównego wpływa na to, czy nie ma z tym nic wspólnego?

Cóż, nie sądzę, że ma to wpływ, mierzymy wydajność GPU, nie ma to nic wspólnego z dyskiem twardym

Witam. Jeśli masz więcej niż jeden procesor graficzny, czy można zobaczyć wydajność każdego z nich? W moim przypadku są trzy NVIDIA.

Jeśli nie masz włączonej właściwości vsync GPU, to niezależnie od tego, jaki masz GPU, da ci 60 FPS

Cóż w xfce jak usunę panel ekranu vsybc jest dezaktywowany iw moim gpu osiąga 5362 fps

Zostawię ci wskazówkę, która ma związek z FPS na wypadek, gdyby komuś pomógł (nie radzę mieć 2 GPU (intel + Nvidia)), ponieważ na przykład z parą miałem problemy.

Chodzi o dezaktywację synchronizacji pionowej, z którą uzyskuje się wiele FPS; D.

a pulpit jest super płynny!

Dobrze zaczerpnięte z arch wiki https://wiki.archlinux.org/index.php/Intel_graphics

Wyjaśniam sprawę:

edytuj plik intel:

vi /etc/X11/xorg.conf.d/20-intel.conflub inny plik w moim przypadku zrobiłem ręczny dodając opcję «TearFree».

następnie utwórz plik w domu

~/.drirci zawierać następujące elementy:

następnie uruchom ponownie i to wszystko!

kolejna rzecz, o której nie można zapomnieć optirun lub primusrun dla dedykowanych procesorów graficznych.

Pozdrowienia!

plik .drirc nie był widoczny

Może to z powodu problemu z tagiem, na wszelki wypadek jest na arch wiki.

Glxgears mając włączoną synchronizację pionową mierzy tylko fps ekranu (chodzi mi o częstotliwość odświeżania ekranu ok 60), żeby mierzył wydajność wykresu, trzeba dezaktywować synchronizację pionową chyba tak jest z:

vblank_mode = 0 glxgears, co znacznie zwiększy liczby