Apple je najavio dolazak novih funkcija ID fotografije sa iOS -om koji će koristiti algoritme za heširanje kako bi odgovarao sadržaju fotografija u galeriji korisnika sa poznatim elementima zlostavljanja djece. Uređaj će zatim otpremiti skup otisaka prstiju koji predstavljaju ilegalni sadržaj, a zatim će svaku fotografiju u galeriji korisnika upariti s tom listom.

Kao takva, ova funkcija zvuči sjajno, ali u stvarnosti predstavlja i pravi problem, budući da to mnogi od nas mogu zamisliti to može izazvati mnogo sukoba, posebno s "lažno pozitivnim rezultatima", a sudeći prema količini negativnih kritika Applea, ova inicijativa vjerovatno nije najbolja od kompanije u borbi protiv pedofilije i dječije pornografije.

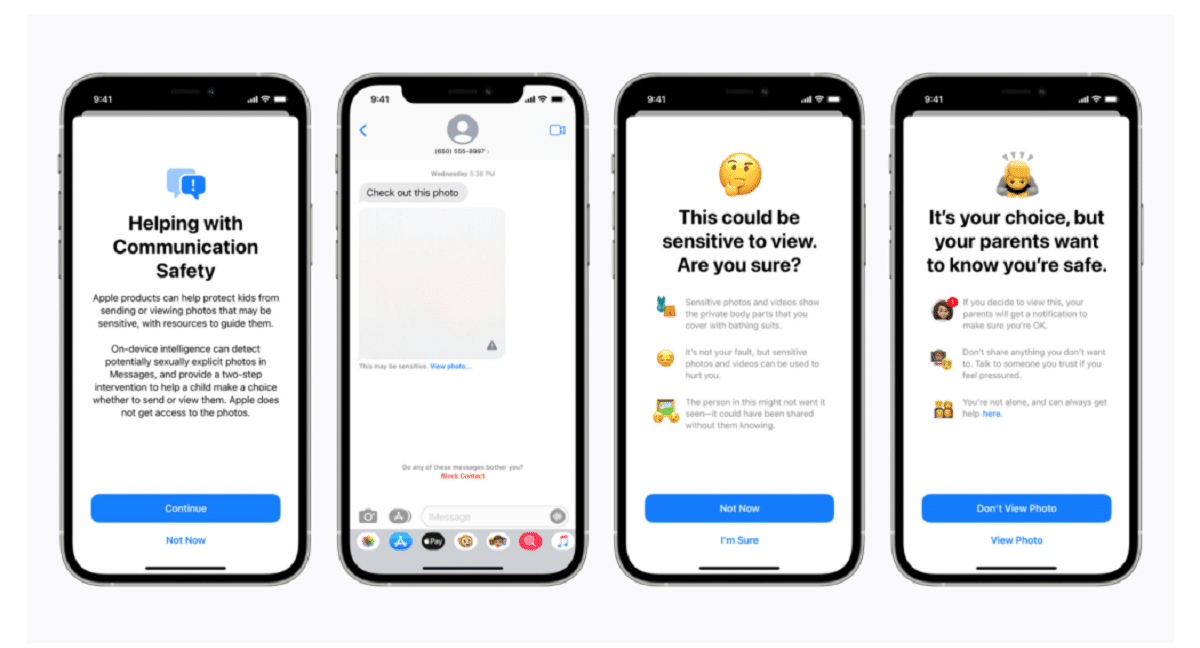

Apple je to potvrdio na svom blogu, rekavši da je tehnologija skeniranja dio nove serije sistema za zaštitu djece koji će se "razvijati i razvijati s vremenom". Funkcije bit će predstavljen kao dio iOS 15, čije je pokretanje zakazano za sljedeći mjesec.

"Ova revolucionarna nova tehnologija omogućava Appleu da pruži vrijedne i djelotvorne informacije Nacionalnom centru za nestalu i eksploatiranu djecu i policiji o širenju poznatih materijala o seksualnom zlostavljanju djece", saopćila je kompanija.

Sistem, tzv neuralMatch, proaktivno će upozoriti tim ljudskih ispitivača ako mislite da su otkrivene ilegalne slike koji će kontaktirati policiju ako se materijal može provjeriti. Sistem neuralMatch, koji je obučen sa 200.000 slika iz Nacionalnog centra za nestalu i eksploatiranu djecu, bit će prvi put postavljen u Sjedinjenim Državama. Fotografije će se heširati i uporediti s bazom poznatih slika seksualnog zlostavljanja djece.

Prema objašnjenjima kompanije Apple svaka fotografija postavljena na iCloud u Sjedinjenim Državama dobit će "sigurnosni bonus" ukazujući da li je sumnjivo ili ne. Stoga, nakon što određeni broj fotografija bude označen kao sumnjiv, Apple će dozvoliti dešifriranje svih sumnjivih fotografija i, ako izgledaju nezakonito, proslijedit će ih nadležnim vlastima.

"Apple vidi fotografije korisnika samo ako imaju zbirku poznatih CSAM -ova na svom računu iCloud Photos", rekla je kompanija u pokušaju da uvjeri korisnike da su njihovi podaci povjerljivi.

Treba istaći to neuralMatch predstavlja najnoviji Appleov pokušaj kompromisa između vlastitog obećanja o zaštiti privatnosti korisnika i zahtjeva vlada., agencije za provođenje zakona i aktivisti za zaštitu djece za povećanu pomoć u krivičnim istragama, uključujući terorizam i dječju pornografiju. Napetost između tehnoloških kompanija poput Applea i Facebooka, koje su zagovarale sve veću upotrebu šifriranja u svojim proizvodima i uslugama, a provedba zakona samo se pojačala od 2016.

Matthew Green, profesor i kriptograf sa Univerziteta Johns Hopkins, podijelio je u srijedu navečer svoju zabrinutost u vezi sa sistemom. "Ova vrsta alata može biti blagodat za pronalaženje dječije pornografije na telefonima ljudi", rekao je Green.

"Ali zamislite šta bi mogla učiniti u rukama autoritarne vlade", upitao je. Ovo zabrinjava istraživače sigurnosti koji upozoravaju da bi to moglo otvoriti vrata praćenju ličnih uređaja miliona ljudi. Sigurnosni istraživači, podržavajući Appleove napore u borbi protiv zlostavljanja djece, strahuju da bi kompanija mogla dopustiti vladama širom svijeta da traže pristup ličnim podacima njihovih građana, što je potencijalno daleko iznad njihove prvobitne namjere.

Presedan koji je napravio Apple mogao bi povećati i pritisak na druge tehnološke kompanije da koriste slične tehnike. "Vlade će to zahtijevati od svih", rekao je Green.

Sustavi za pohranu fotografija u oblaku i web stranice društvenih medija već traže slike zlostavljanja djece. Apple koristi, na primjer, tehnike heširanja kada se fotografije prenose u iCloud fotografije. Sve fotografije učitane u iCloud Fotografije za sigurnosnu kopiju i sinkronizaciju ne pohranjuju se u end-to-end šifriranje. Fotografije se pohranjuju u šifriranom obliku na Apple farmama, ali ključevi za dešifriranje također su u vlasništvu Applea. To znači da policija može pozvati Apple i vidjeti sve fotografije koje je postavio korisnik.

Izvor: https://www.apple.com

Kakav idiotizam. Šta je sa roditeljima koji fotografišu svoje bebe?

To je pitanje koje ide u lažno pozitivno mišljenje

Ne bih se začudio da ćete, čim nova funkcija izađe, biti uznemireni zbog prekomjernog broja "pedofila" koji koriste Appleove proizvode.

Ovo se naziva ulazna vrata i vlade će dati jedna drugoj da imaju ključ, pornografija se čini "osjetljivim" izgovorom da je ljudi progutaju, ali pedofili neće ubosti, oni će šifrirati osjetljiv sadržaj. Zatim se postavlja pitanje bilo kojeg para koji fotografira svoju malu djecu S kojim pravom Apple, ili bilo tko drugi, zabada nos u taj sadržaj. Konačno, stražnja vrata su dobra za sve, kad se otvore i budu u bilo čijim rukama. Hoće li se ograničiti na bavljenje pornografijom, sa ključevima svega?

Zanimljivost svega ovoga je da je u jednom trenutku neko ljudsko biće obučavalo tu stvar ili predložilo uzorke, u mom ličnom slučaju ne toleriram bilo kakvu krv, nasilje i tema pedofilije je nešto što je zaista traumatično i bolno za ja.

Jebeš takav posao hahaha