Apple ilmoitti uusien ominaisuuksien saapumisesta valokuvallinen tunnus iOS: ssä, joka käyttää hajautusalgoritmeja gallerian valokuvien sisällön vastaamiseksi käyttäjistä tunnetuilla lasten hyväksikäytön osilla. Laite lähettää sitten joukon sormenjälkiä, jotka edustavat laitonta sisältöä, ja vertaa sitten käyttäjän galleriassa olevia valokuvia kyseiseen luetteloon.

Tämä toiminto kuulostaa sinänsä hienolta, mutta todellisuudessa se edustaa myös todellista ongelmaa, koska kuten monet meistä voivat kuvitella, tämä se voi aiheuttaa paljon konflikteja, varsinkin "vääriä positiivisia" ja se, että Applen negatiivisten arvostelujen määrän perusteella tämä aloite ei ehkä ole yrityksen paras taistelussa pedofiliaa ja lapsipornografiaa vastaan.

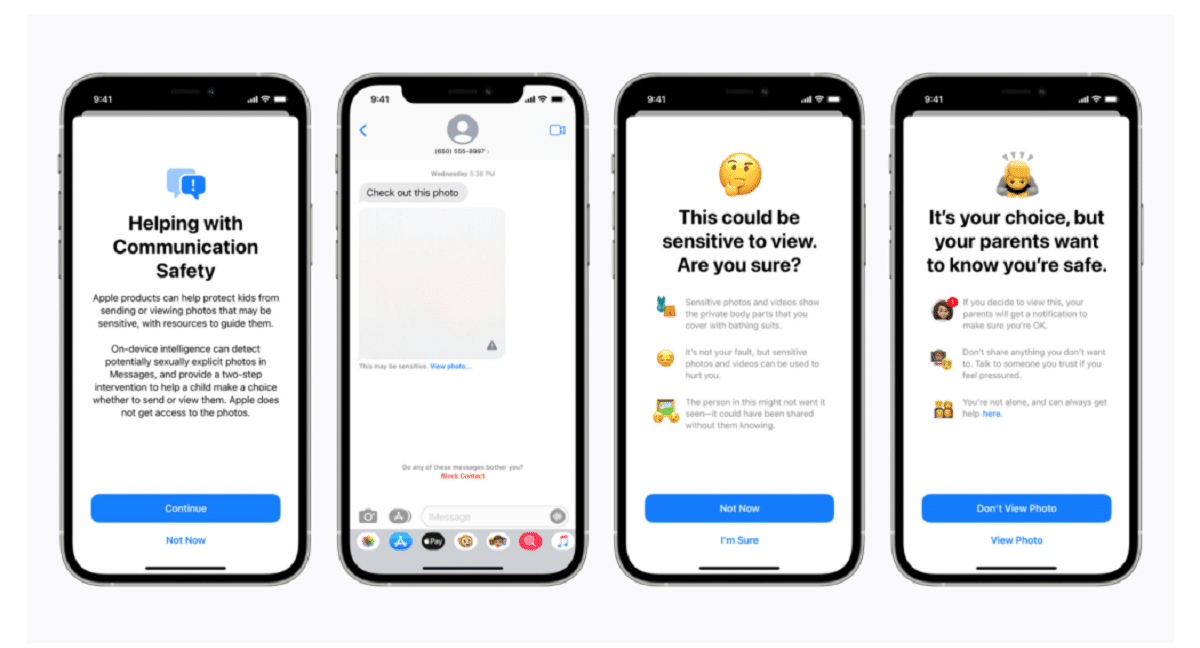

Apple vahvisti blogikirjoituksessaan, että skannaustekniikka on osa uutta lastensuojelujärjestelmää, joka "kehittyy ja kehittyy ajan myötä". Toiminnot julkaistaan osana iOS 15: tä, jonka on määrä käynnistyä ensi kuussa.

"Tämän uraauurtavan uuden teknologian avulla Apple voi tarjota arvokasta ja toimivaa tietoa kadonneiden ja hyväksikäytettyjen lasten kansalliselle keskukselle ja lainvalvontaviranomaisille tunnetun lasten seksuaalisen hyväksikäytön materiaalin leviämisestä", yhtiö sanoi.

Järjestelmä, ns neuralMatch, varoittaa ennakoivasti inhimillisten tutkijoiden tiimiä jos mielestäsi havaitaan laittomia kuvia joka ottaa yhteyttä poliisiin, jos aineisto voidaan todentaa. NeuralMatch -järjestelmä, joka on koulutettu 200.000 XNUMX kuvan kanssa National Center for Missing & Exploited Children, otetaan käyttöön ensimmäistä kertaa Yhdysvalloissa. Valokuvat hajautetaan ja verrataan tietokantaan, jossa on tunnettuja lasten seksuaalisen hyväksikäytön kuvia.

Applen selitysten mukaan jokainen Yhdysvalloissa iCloudiin ladattu valokuva saa "turvallisuusbonuksen" osoittaa onko se epäilyttävää vai ei. Siksi, kun tietty määrä valokuvia on merkitty epäilyttäviksi, Apple sallii kaikkien epäilyttävien kuvien salauksen purkamisen ja, jos ne näyttävät laittomilta, välittää ne asianmukaisille viranomaisille.

"Apple näkee käyttäjien kuvat vain, jos heillä on kokoelma tunnettuja CSAM -tiedostoja iCloud Photos -tilillään", yritys sanoi yrittäessään vakuuttaa käyttäjille, että heidän tietonsa ovat luottamuksellisia.

On huomattava, että neuralMatch edustaa Applen viimeistä yritystä tehdä kompromisseja lupauksensa suojella asiakkaiden yksityisyyttä ja hallitusten vaatimusten välillä., lainvalvontaviranomaisia ja lapsiturvallisuusaktivisteja lisäämään apua rikostutkimuksissa, mukaan lukien terrorismi ja lapsipornografia. Jännitys teknologiayritysten, kuten Applen ja Facebookin, välillä, jotka ovat puolustaneet salauksen entistä laajempaa käyttöä tuotteissaan ja palveluissaan, ja lainvalvonta on vain kiristynyt vuodesta 2016.

John Hopkinsin yliopiston professori ja salakirjoittaja Matthew Green jakoi huolensa järjestelmästä Twitterissä keskiviikkoiltana. "Tällainen työkalu voi olla siunaus lapsipornografian löytämiselle ihmisten puhelimista", Green sanoi.

"Mutta kuvitelkaa, mitä se voisi tehdä autoritaarisen hallituksen käsissä", hän kysyi. Tämä huolestuttaa tietoturvatutkijoita, jotka varoittavat, että se voi avata oven miljoonien ihmisten henkilökohtaisten laitteiden seurantaan. Vaikka tietoturvatutkijat tukevat Applen pyrkimyksiä torjua lasten hyväksikäyttöä, he pelkäävät, että yhtiö voi antaa hallituksille ympäri maailmaa saada pääsyn kansalaistensa henkilötietoihin, mahdollisesti paljon alkuperäistä tarkoitusta pidemmälle.

Applen luoma ennakkotapaus voi myös lisätä painetta muihin teknologiayrityksiin käyttämään samanlaisia tekniikoita. "Hallitukset vaativat sitä kaikilta", Green sanoi.

Pilvivalokuvien tallennusjärjestelmät ja sosiaalisen median sivustot etsivät jo kuvia lasten hyväksikäytöstä. Apple käyttää esimerkiksi hajautustekniikoita, kun valokuvia ladataan iCloud -valokuviin. Kaikkia iCloud Photosiin varmuuskopiointia ja synkronointia varten ladattuja valokuvia ei tallenneta päästä päähän -salaukseen. Valokuvat tallennetaan salatussa muodossa Applen tiloille, mutta salauksen avaimet ovat myös Applen omistuksessa. Tämä tarkoittaa sitä, että poliisi voi haastaa Applen ja nähdä kaikki käyttäjän lataamat valokuvat.

lähde: https://www.apple.com

Mikä idiotismi. Entä vanhemmat, jotka ottavat valokuvia vauvoistaan?

Tämä on kysymys, joka menee vääriin positiivisiin asioihin

En olisi yllättynyt, jos heti kun uusi ominaisuus julkaistaan, olet huolestunut Applen tuotteita käyttävien "pedofiilien" kohtuuttomasta määrästä.

Sitä kutsutaan takaoveksi, ja hallitukset antavat toisilleen avaimen. Sitten on kysymys kaikista pariskunnista, jotka ottavat valokuvia pienistä lapsistaan. Millä oikeudella Apple tai joku muu pistää nenänsä tähän sisältöön. Lopuksi, takaovi on hyvä kaikelle, kun se on auki ja kenen tahansa käsissä, rajoittuuko se vain pornografian harjoittamiseen ja kaiken avainten hallintaan?

Mielenkiintoista tässä kaikessa on se, että jossain vaiheessa joku oli kouluttanut tuota asiaa tai ehdottanut näytteitä, henkilökohtaisessa tapauksessa en siedä minkäänlaista verenvuotoa, väkivaltaa ja pedofilian aihe on todella traumaattinen ja tuskallinen minä.

Vittu tuollainen työ hahaha