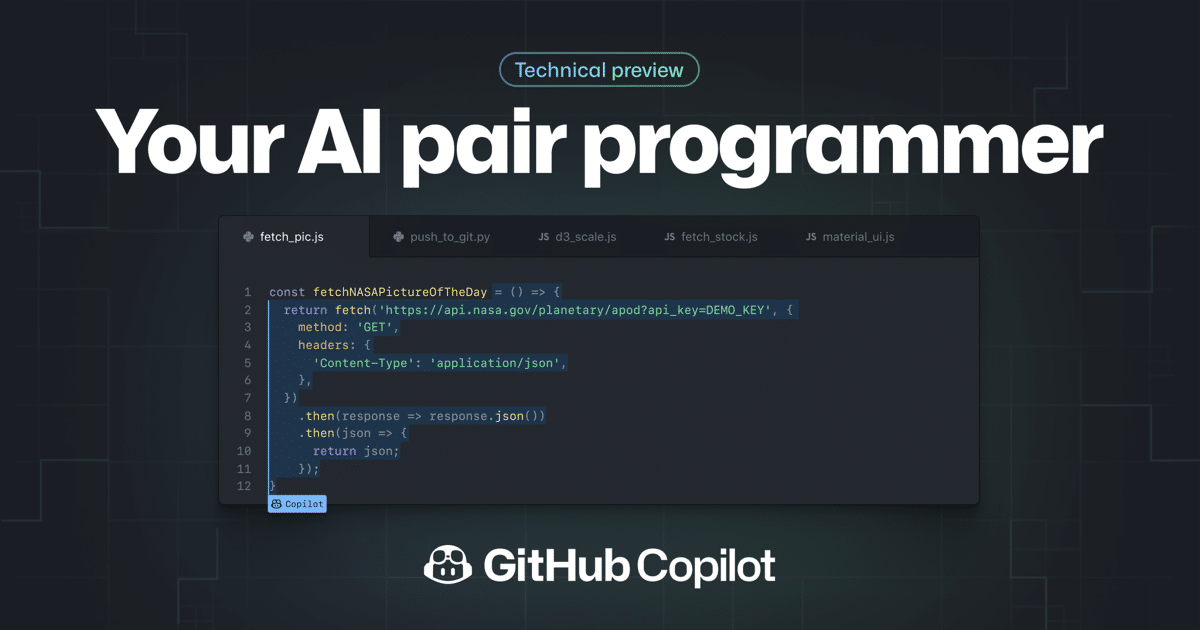

Il n'y a pas longtemps nous partageons ici sur le blog l'actualité de « Copilote » c'est laquelle une IA qui promet de gagner du temps en aidant à l'écriture de code utilisateur avec leurs propres suggestions basées sur des milliards de lignes de code public dont les utilisateurs ont publiquement contribué à GitHub, en utilisant un système d'intelligence artificielle appelé Codex de la société de recherche OpenAI.

Alors que Copilot est un excellent gain de temps et GitHub décrit Copilot comme l'équivalent IA de la "programmation en paire", dans lequel deux développeurs travaillent ensemble sur un seul ordinateur. L'idée est qu'un développeur peut proposer de nouvelles idées ou repérer des problèmes que l'autre développeur aurait pu manquer, même si cela nécessite plus d'heures de travail.

Dans la pratiqueCependant, Copilot est plus un outil utilitaire permettant de gagner du temps car il intègre des ressources que les développeurs devraient chercher ailleurs. Lorsque les utilisateurs saisissent des données dans Copilot, l'outil suggère des extraits pour eux d'ajouter avec le clic d'un bouton. De cette façon, ils n'ont pas à perdre de temps à chercher de la documentation sur l'API ou à chercher des exemples de code sur des sites comme StackOverflow.

Un réseau de neurones sur GitHub Copilot est formé à l'aide d'énormes quantités de données, constituées de code - des millions de lignes téléchargées par les 65 millions d'utilisateurs de GitHub, la plus grande plate-forme au monde permettant aux développeurs de collaborer et de partager leur travail.

L'objectif est que Copilot en apprenne suffisamment sur les modèles de code pour pouvoir pirater tout seul. Vous pouvez prendre le code incomplet d'un partenaire humain et terminer le travail en ajoutant les pièces manquantes. Dans la plupart des cas, il semble réussir à le faire. GitHub prévoit de vendre l'accès à l'outil aux développeurs.

Comme la plupart des outils d'intelligence artificielle, GitHub souhaite également que Copilot devienne plus intelligent au fil du temps en fonction des données qu'il collecte d'utilisateurs.

Lorsque les utilisateurs acceptent ou rejettent les suggestions de Copilot, son modèle d'apprentissage automatique utilisera ces commentaires pour améliorer les suggestions futures, afin que l'outil puisse devenir plus humain au fur et à mesure qu'il apprend.

Peu de temps après le lancement de Copilot, certains développeurs ont commencé à être alarmés par l'utilisation de code public pour former l'intelligence artificielle de l'outil. Une préoccupation est que Si Copilot reproduit des morceaux suffisamment gros de code existant, il pourrait s'agir d'une violation du droit d'auteur ou blanchir le code source ouvert à des fins commerciales sans la licence appropriée.

À propos de ça La Free Software Foundation a annoncé avoir lancé un appel financé pour demander des rapports techniques sur les implications de Copilot pour la communauté du logiciel libre

« Nous savons déjà que Copilot tel qu'il est est inacceptable et injuste, de notre point de vue. Il nécessite l'exécution de logiciels non libres (Visual Studio ou des parties de Visual Studio Code) et Copilot est un service en remplacement du logiciel.

La raison en est que Copilot nécessite l'exécution de logiciels non libres, en tant qu'IDE Visual Studio de Microsoft ou éditeur de Visual Studio Code, maintient la FSF et constitue un « service en remplacement du logiciel », ce qui signifie qu'il s'agit d'un moyen de gagner du pouvoir sur l'informatique des autres.

Étant donné qu'en tant que tel Copilot est une extension Visual Studio Code qui utilise l'apprentissage automatique formé aux logiciels open source sous licence libre pour suggérer des lignes de code ou des fonctionnalités aux développeurs lorsqu'ils écrivent des logiciels.

Cependant, Copilot soulève de nombreuses autres questions qui nécessitent un examen plus approfondi.

« La Free Software Foundation a reçu de nombreuses demandes de renseignements sur notre position sur ces questions. Nous pouvons voir que l'utilisation de logiciels open source par Copilot a de nombreuses implications pour une grande partie de la communauté du logiciel libre. Les développeurs veulent savoir si la formation d'un réseau de neurones dans leur logiciel peut vraiment être considérée comme une utilisation équitable. D'autres qui pourraient être intéressés par l'utilisation de Copilot se demandent si des extraits de code et d'autres éléments copiés à partir de référentiels hébergés sur GitHub pourraient entraîner une violation du droit d'auteur.

source: https://www.fsf.org/