Az Apple bejelentette az új funkciók érkezését fényképes azonosító iOS -en, amely hash algoritmusokat fog használni a galériában lévő fényképek tartalmának egyeztetéséhez a felhasználók száma a gyermekbántalmazás ismert elemeivel. A készülék ezután feltölti az illegális tartalmat reprezentáló ujjlenyomat -készletet, majd összehasonlítja a felhasználó galériájában található összes fotót a listával.

Mint ilyen, ez a funkció nagyszerűen hangzik, de a valóságban valódi problémát is jelent, mivel ezt sokan el tudjuk képzelni sok konfliktust okozhat, különösen a "hamis pozitív" eredményekkel, és az, hogy az Apple -ről szóló negatív vélemények mennyiségéből ítélve, ez a kezdeményezés valószínűleg nem a legjobb a cégben a pedofília és a gyermekpornográfia elleni küzdelemben.

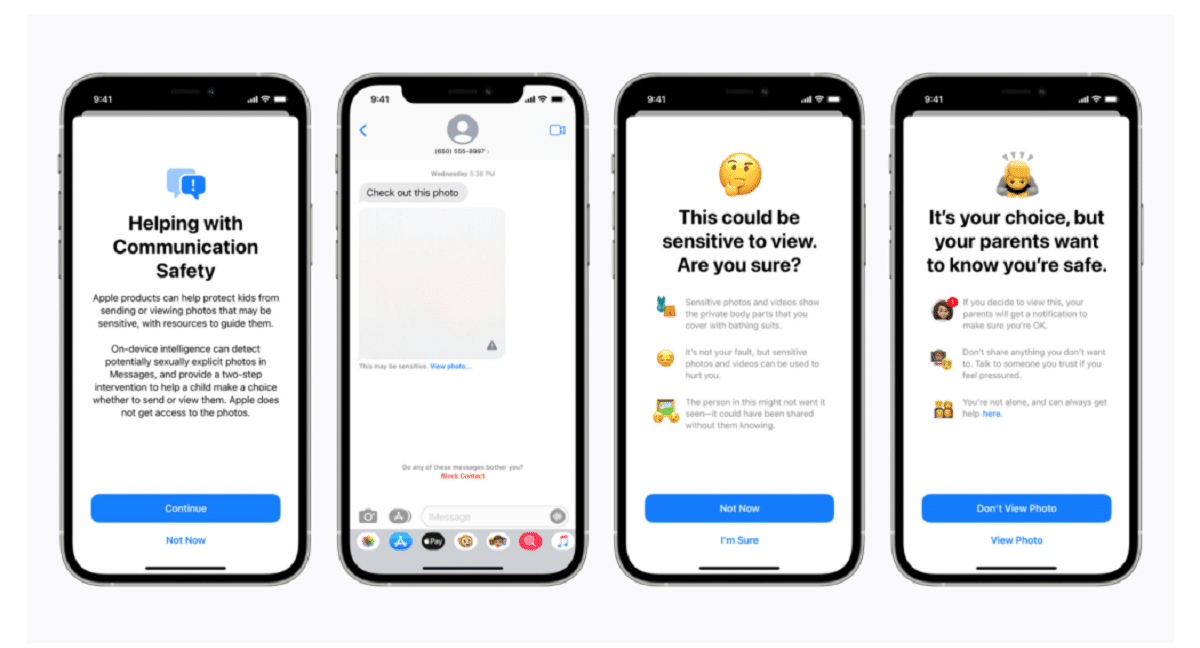

Az Apple egy blogbejegyzésben megerősítette, hogy a szkennelési technológia egy új gyermekvédelmi rendszer része, amely "idővel fejlődik és fejlődik". A funkciók az iOS 15 részeként kerül bevezetésre, amely a tervek szerint a jövő hónapban indul.

"Ez az úttörő új technológia lehetővé teszi az Apple számára, hogy értékes és cselekvőképes információkat nyújtson az eltűnt és kizsákmányolt gyermekek nemzeti központjának és a bűnüldöző szerveknek az ismert gyermeki szexuális bántalmazással kapcsolatos anyagok terjedéséről" - mondta a vállalat.

A rendszer, az ún A neuralMatch proaktívan figyelmezteti az emberi vizsgáztatók csapatát ha úgy gondolja, hogy illegális képeket észlel aki felveszi a kapcsolatot a rendőrséggel, ha az anyag ellenőrizhető. A neuralMatch rendszert, amelyet 200.000 ezer képpel képeztek ki az eltűnt és kizsákmányolt gyermekek nemzeti központjából, először telepítik az Egyesült Államokban. A fényképeket kivonatolják, és összehasonlítják az ismert gyermekekkel való szexuális bántalmazásról készült képek adatbázisával.

Az Apple magyarázata szerint minden egyes, az Egyesült Államokban az iCloud -ba feltöltött fotó "biztonsági bónuszt" kap jelezve, hogy gyanús -e vagy sem. Ezért, ha bizonyos számú fényképet gyanúsnak jelöltek meg, az Apple lehetővé teszi az összes gyanús fotó visszafejtését, és ha illegálisnak tűnik, továbbítja azokat a megfelelő hatóságoknak.

"Az Apple csak akkor látja a felhasználók fényképeit, ha ismert CSAM -gyűjteményük van az iCloud Photos -fiókjukban" - közölte a vállalat, ezzel biztosítva a felhasználókat arról, hogy adataik bizalmasak.

Meg kell jegyezni, hogy A neuralMatch az Apple legújabb kísérlete, amely kompromisszumot köt az ügyfelek magánéletének védelme érdekében tett ígérete és a kormányok igényei között., a bűnüldöző szervek és a gyermekbiztonsági aktivisták, hogy fokozott segítséget nyújtsanak a bűnügyi nyomozásokban, beleértve a terrorizmust és a gyermekpornográfiát. A feszültség olyan technológiai cégek, mint az Apple és a Facebook között, amelyek a termékeikben és szolgáltatásaikban egyre nagyobb titkosítást alkalmaztak, és a bűnüldözés csak fokozódott 2016 óta.

Matthew Green, a Johns Hopkins Egyetem professzora és titkosítója szerdán este a Twitteren osztotta meg aggályait a rendszerrel kapcsolatban. "Ez a fajta eszköz áldás lehet a gyermekpornográfia megtalálására az emberek telefonjain" - mondta Green.

"De képzelje el, mit tehetne egy tekintélyelvű kormány kezében" - kérdezte. Ez aggasztja a biztonsági kutatókat, akik arra figyelmeztetnek, hogy ez ajtót nyithat emberek millióinak személyes eszközeinek megfigyelésére. A biztonsági kutatók, miközben támogatják az Apple gyermekbántalmazás elleni küzdelmét, attól tartanak, hogy a vállalat világszerte lehetővé teheti a kormányok számára, hogy hozzáférjenek polgáraik személyes adataihoz, ami messze meghaladja eredeti szándékát.

Az Apple által létrehozott precedens növelheti a nyomást más technológiai cégekre is, hogy hasonló technikákat alkalmazzanak. "A kormányok mindenkitől követelni fogják" - mondta Green.

A felhőfénykép -tároló rendszerek és a közösségi oldalak már keresik a gyermekbántalmazás képeit. Az Apple például kivonatolási technikákat használ, amikor fényképeket tölt fel az iCloud Fotókba. Az iCloud Fotókba biztonsági mentés és szinkronizálás céljából feltöltött összes fénykép nem kerül végső titkosításba. A fényképeket titkosított formában tárolják az Apple farmokon, de a visszafejtési kulcsok is az Apple tulajdonában vannak. Ez azt jelenti, hogy a rendőrség beidézheti az Apple -t, és megtekintheti a felhasználó által feltöltött összes fényképet.

forrás: https://www.apple.com

Micsoda idiotizmus. Mi a helyzet a szülőkkel, akik fotóznak a babájukról?

Ez egy olyan kérdés, amely hamis pozitívumokba megy át

Nem lennék meglepve, ha amint megjelenik az új funkció, riasztani fogja az Apple termékeit használó "pedofilok" aránytalan száma.

Ezt hátsó ajtónak hívják, és a kormányok átadják magukat egymásnak a kulcs birtokában, a pornográfia "érzékeny" ürügynek tűnik az emberek számára, hogy lenyeljék, de a pedofilok nem fognak csípni, titkosítani fogják az érzékeny tartalmat. Aztán felmerül a kérdés, hogy minden pár, akik fényképeket készítenek kisgyermekeikről. Milyen jogon dugja bele az orrát az Apple vagy bárki más. Végül a hátsó ajtó mindenre jó, ha kinyitják, és bárki kezében van.

Az az érdekes ebben az egészben, hogy valamikor volt egy ember, aki kiképezte ezt a dolgot, vagy mintákat javasolt, az én személyes esetemben nem tűrök semmilyen vérzést, erőszakot, és a pedofília témája valóban traumatikus és fájdalmas. nekem.

Bassza meg ezt a fajta munkát hahaha